Marcella Cornia ha vinto il Premio giovani ricercatori edizione 2020 categoria Intelligenza artificiale e big data per il paper: "Predicting Human Eye Fixations via an LSTM-based Saliency Attentive Model", pubblicato su IEEE Transactions on Image Processing nel 2018.

Motivazione: Il Lavoro si focalizza su un problema importante della computer vision ovvero quello di predire le aree di fissazione dell’occhio umano sulle immagini. Il lavoro presenta significativi aspetti innovativi e fornisce importanti risultati sperimentali, è stato pubblicato su una delle riviste più importanti del settore ed in meno di due anni ha già ricevuto più di duecentocinquanta citazioni.

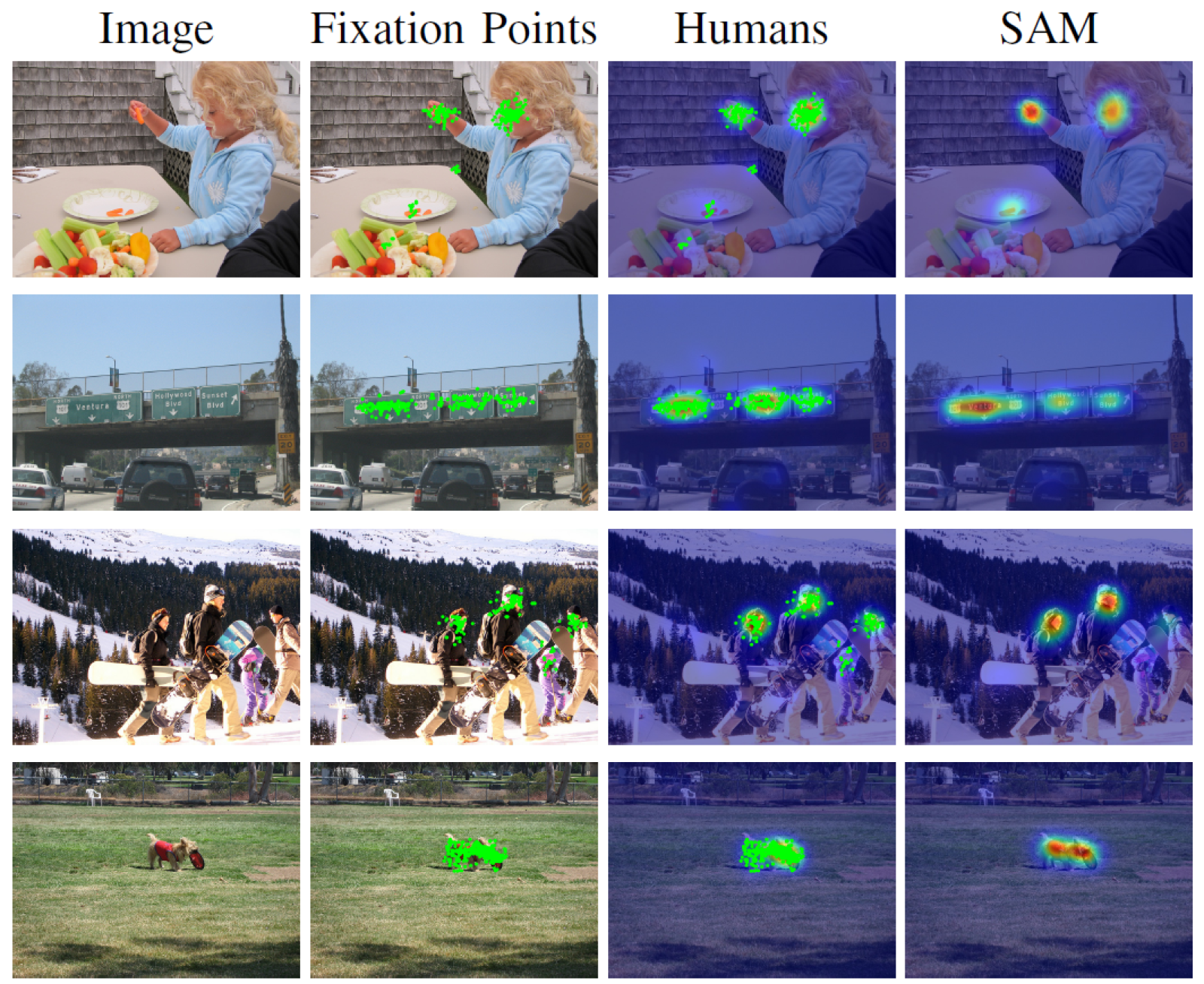

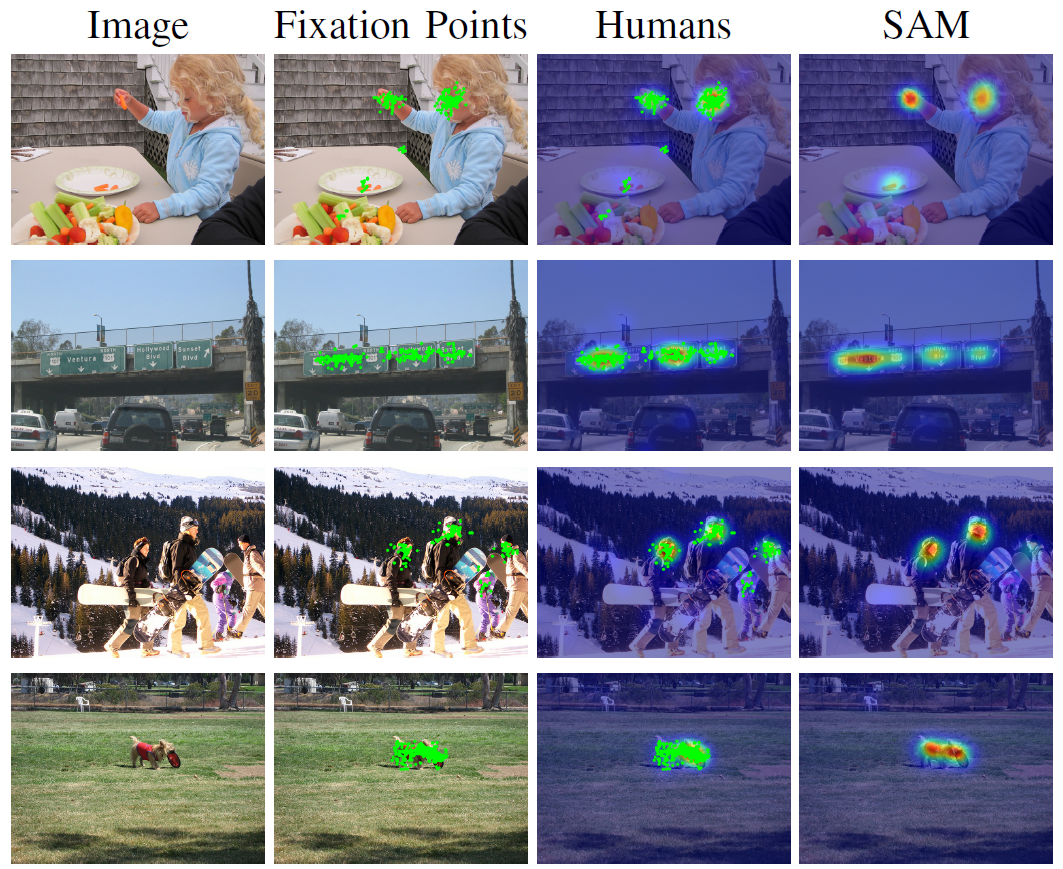

Quando un essere umano guarda un’immagine o un video, non focalizza il suo sguardo su tutte le regioni dell’immagine o del video con la stessa intensità, ma viene invece attratto dalle regioni più salienti e rilevanti della scena. Questo problema, chiamato predizione della salienza di immagini e video, è stato studiato per molti anni nell’ambito delle neuroscienze e dell’intelligenza artificiale risultando in diversi algoritmi in grado di emulare il focus dell’attenzione degli esseri umani.

La predizione della salienza su immagini e video è risultata efficace in moltissimi contesti e, in particolare nell’ambito dell’intelligenza artificiale, è stata applicata per migliorare task specifici tra i quali la descrizione in linguaggio naturale della scena, il riconoscimento di oggetti, il tracking delle persone, il cropping automatico delle immagini e la compressione dei video. Data l’estrema importanza e utilità della predizione della salienza, negli ultimi anni sono stati fatti numerosi sforzi in questa direzione e le attività di ricerca derivanti sono sfociate in molteplici modelli matematici in grado di predire in modo automatico una mappa di salienza che evidenzi quali aree dell’immagine o del video attirano maggiormente l’attenzione dagli esseri umani. In particolare, grazie alla grandissima diffusione del Deep Learning, la predizione automatica della salienza su immagini ha raggiunto prestazioni molto vicine a quelle degli esseri umani.

Il lavoro presentato si colloca in questo settore e introduce un nuovo modello per la predizione della salienza su immagini basato interamente su tecniche di Deep Learning. Nel dettaglio, il modello proposto, chiamato Saliency Attentive Model (SAM), è composto da una rete convolutiva ricorrente che rifinisce la mappa di salienza predetta in modo iterativo grazie a meccanismi neurali attentivi che identificano le aree più importanti della scena. Inoltre, l’architettura introdotta tiene conto di un’importante proprietà dello sguardo degli esseri umani: quando l’immagine non contiene regioni particolarmente rilevanti, gli esseri umani tendono a focalizzarsi maggiormente sul centro della scena portando così ad avere un forte bias centrale nelle mappe di salienza. Per incorporare questo bias centrale, SAM integra una serie di “prior map”, imparate durante la fase di addestramento, che permettono di pesare maggiormente il centro della scena durante la predizione delle mappe di salienza.

Come la maggior parte dei modelli basati su Deep Learning, SAM è stato addestrato su grandi quantità di dati in cui ogni immagine è disponibile con la correspettiva mappa di salienza ottenuta mediando le osservazioni di un numero consistente di persone. Tipicamente, questi dati vengono raccolti grazie a sistemi di eye-tracking che registrano i punti di fissazione degli esseri umani durante l’osservazione dell’immagine e dai quali è poi possibile stimare la mappa di salienza per quella immagine.

Per valutare le prestazioni del modello proposto, sono stati fatti numerosi esperimenti su diversi benchmark pubblici per la predizione della salienza su immagini. In particolare, SAM è stato testato sul dataset più grande disponibile in letteratura per questo task, SALICON, e sul MIT Saliency Benchmark che contiene una grande diversità tra le immagini che lo compongono ed è il benchmark di maggiore riferimento nell’ambito della predizione della salienza. I risultati sperimentali hanno dimostrato che il modello proposto è stato in grado di superare largamente lo stato dell’arte in questo task, posizionandosi al primo posto nelle classifiche di entrambi i benchmark considerati. Inoltre, poco prima della sua pubblicazione su IEEE Transactions on Image Processing che attualmente è tra le riviste più importanti nell’ambito della Visione e Intelligenza Artificiale, SAM ha vinto un’importante competizione internazionale per la predizione della salienza: la LSUN Saliency Prediction Challenge.

L’articolo presentato è stato largamente apprezzato dalla comunità scientifica raggiungendo più di 270 citazioni in poco più di due anni (fonte Google Scholar) e diventando un articolo di riferimento per quanto riguarda il task considerato.

Figura 1. La predizione della salienza su immagini mira a stimare in modo automatico le aree che attraggono lo sguardo degli esseri umani a prima vista. Questa informazione viene tipicamente raccolta utilizzando sistemi di eye-tracking che raccolgono i punti di fissazione degli esseri umani dai quali è poi possibile ottenere la mappa di salienza di una data immagine. Il modello presentato nell’articolo impara a predire in modo automatico la distribuzione dei punti di fissazione degli esseri umani e a stimare la correspettiva mappa di salienza.